L’immagine liquida: il futuro della fotografia?

L’immagine liquida, l’immagine viva: il futuro della fotografia dopo la sua morte. Perché “La fotografia è morta”.

È proprio vero?

Certamente si. Molti fotografi, filosofi, commentatori e critici d’arte ci dicono da tempo di si; la fotografia è nata a metà dell’Ottocento, e a loro opinione, come molte altre forme d’arte, estrapolata dal suo contesto documentaristico o storico, non ha più nulla di nuovo da trasmettere. Nient’altro da inventare.

Ciò è … da un certo punto di vista, vero: che cosa possiamo fare, infatti, per introdurre – per creare – qualcosa di non già visto prima in un’altra fotografia?

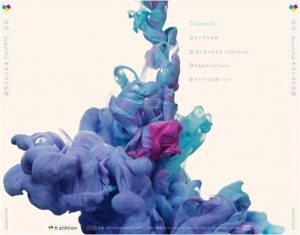

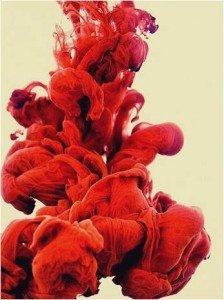

Abbiamo, invero, degli strumenti a disposizione per farlo, ma occorre introdurre degli artifizi. O riprendere in mano vecchie tecniche e strumenti quasi dimenticati. Alberto Seveso, ad esempio – fotografo, illustratore e grafico – si è servito della fotografia ad alta velocità e di recipienti pieni d’olio, o di liquido denso e adatto allo scopo, nel quale ha rovesciato dei colori fotografando poi il loro espandersi nello spazio. Questo tipo di fotografia, definita come “liquida”, può ottenere risultati molto diversi a seconda delle tecniche e dei mezzi utilizzati. L’ispirazione viene da lontano: Jackson Pollock, espressionismo astratto e ‘Action Painting‘.

Abbiamo, invero, degli strumenti a disposizione per farlo, ma occorre introdurre degli artifizi. O riprendere in mano vecchie tecniche e strumenti quasi dimenticati. Alberto Seveso, ad esempio – fotografo, illustratore e grafico – si è servito della fotografia ad alta velocità e di recipienti pieni d’olio, o di liquido denso e adatto allo scopo, nel quale ha rovesciato dei colori fotografando poi il loro espandersi nello spazio. Questo tipo di fotografia, definita come “liquida”, può ottenere risultati molto diversi a seconda delle tecniche e dei mezzi utilizzati. L’ispirazione viene da lontano: Jackson Pollock, espressionismo astratto e ‘Action Painting‘.

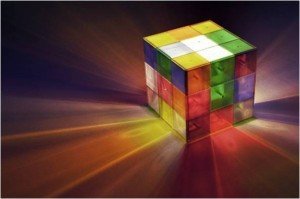

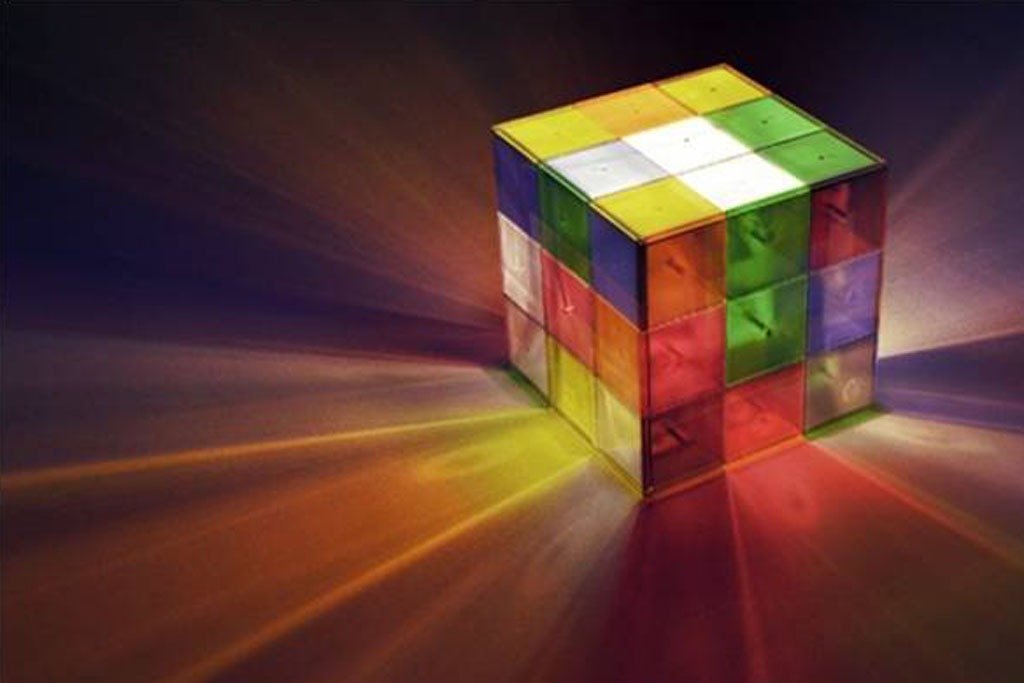

Non parleremo, però, qui, di ‘fotografia dei liquidi’ come quella di Alberto Seveso; per ‘fotografia liquida’ qui e ora intendiamo una cosa diversa: il muoversi verso nuovi concetti fotografici . In particolare le foto di Seveso danno lo spunto per parlare della fotografia plenottica, ovvero del mezzo tecnico che permette di fotografare un ‘cubo di luce’ e ciò che in esso è contenuto. ‘Cubo di luce’ che è per sua stessa natura un ambiente ‘liquido’ (oggetti immersi in aria, oggetti immersi nel liquido, nello spazio), analogo ai fusti pieni d’olio di Seveso.

D’ora in poi, quando diciamo ‘fotografia liquida’, ci riferiremo a un nuovo modo di guardare (e di fotografare) che si esprime in tre e addirittura quattro dimensioni.

“Lightfield photo”: campi di luce.

“Lightfield photo”: campi di luce.

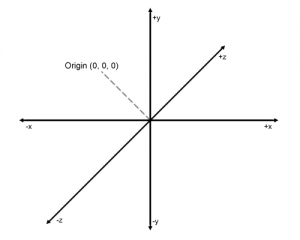

Il ‘campo di luce’ in matematica è una funzione (che vuol dire ‘applicazione‘, ‘trasformazione‘) che viene definita come l’insieme di tutti i raggi di luce in qualsiasi e tutti i punti dello spazio viaggianti in qualsiasi e tutte le direzioni. Ricordiamo, dalla fisica, che la luce è qualcosa che sfugge a una semplice definizione: si diffonde nello spazio e segue le regole dell’elettromagnetismo, ma è anche e allo stesso tempo direzionale (il raggio di luce ha un suo orientamento) e formata da corpuscoli.

Essenzialmente, quindi, il ‘campo di luce’ è un insieme di dati ad almeno quattro dimensioni (‘4-D Field’), perché qualsiasi punto del raggio di luce ‘fermato’, ‘congelato’ in uno spazio tridimensionale riceve anche come attributo una direzione (la sua ‘quarta dimensione’)

Il concetto di ‘campo di luce’ venne trasformato in modello teorico negli anni Novanta, e trova applicazione nella risoluzione di molti problemi di computer grafica e modellazione tridimensionale. La genesi della teoria è molto precedente: si torna indietro nel tempo, a metà dell’Ottocento, con Michael Faraday (che, incredibilmente, non amava la matematica, ‘oscuratrice del contatto diretto con la realtà’). Suona un po’ ‘film di fantascienza’? Eppure, è realtà.

Come funziona la fotografia dei ‘campi di luce’?

Come funziona la fotografia dei ‘campi di luce’?

Le fotocamere tradizionali – sia analogiche che digitali – catturano solo la rappresentazione bidimensionale di una scena, utilizzando due delle dimensioni disponibili nello spazio – quelle sugli assi X e Y di un diagramma cartesiano: sono le due grandezze che la pellicola e il sensore possono comprendere e registrare. La profondità (l ‘asse Z’) sulla fotografia, che possiamo in un certo senso ritrovare nella profondità di campo, è nella fotografia una percezione, non una grandezza, e deriva da un effetto ottico: su una fotografia, una volta venuti a conoscenza della scala (i rapporti ottici), possiamo misurare con il righello lato e altezza ma non profondità, e non possiamo capire quanto distanti siano gli oggetti (a meno di non ricorrere a un confronto di meta dati – quindi, a un confronto con altre informazioni e altre grandezze).

Il passaggio da una macchina fotografica tradizionale (come la Kodak 177, primo e preferito ‘gioco serio’ di chi scrive e piccolo gioiello degli anni Settanta, che avvicinava la fotografia ai bambini e ai ragazzi) a una Reflex digitale come la Canon 5D ed equivalenti è molto lineare, e non ci impone nessun cambio di concetto o di visione rispetto alla fotografia analogica.

Fra la ‘piccola camera oscura’ che costituisce il cuore di una macchina fotografica analogica e quello che sta dentro a una fotocamera digitale non c’è, concettualmente, gran differenza. Cambia il media: da pellicola a sensore, da rullino da sviluppare a file di dati (un peccato il fatto che, per la Kodak 177, non vengano più fabbricati i caricatori e le pellicole).

Sia la Reflex digitale che la Kodak 177 ci ripropongono la visione di un’immagine ribaltata attraverso un foro: un’immagine bidimensionale che, con lo scatto, andiamo a memorizzare su un supporto. Non è così per il passaggio alla fotocamera plenottica: il fotografare un ‘cubo di luce’ ci permette di ragionare in maniera completamente diversa. Al di là della qualità tecnica, questo è il motivo per cui la nuova soluzione tecnica rappresenta un passo importante.

Le fotocamere a ‘campo di luce’ (o plenottiche) sono dotate di un Array (o sistema) di micro lenti posizionato davanti al sensore. Questo sistema di lenti è costituito da molti elementi ottici microscopici (spesso, decine di migliaia) di ridottissima lunghezza focale (fino a 0.15mm): dei veri e propri micro obiettivi. I sistemi di lenti scompongono la luce (e l’immagine) in singoli raggi che raggiungono poi il sensore. L’immagine ‘raw’ (i dati non elaborati catturati dal sensore) risultante è composta da tante singole fotografie (micro fotografie) quante sono le micro lenti – quindi, ad oggi, fino a decine di migliaia.

Le fotocamere a ‘campo di luce’ (o plenottiche) sono dotate di un Array (o sistema) di micro lenti posizionato davanti al sensore. Questo sistema di lenti è costituito da molti elementi ottici microscopici (spesso, decine di migliaia) di ridottissima lunghezza focale (fino a 0.15mm): dei veri e propri micro obiettivi. I sistemi di lenti scompongono la luce (e l’immagine) in singoli raggi che raggiungono poi il sensore. L’immagine ‘raw’ (i dati non elaborati catturati dal sensore) risultante è composta da tante singole fotografie (micro fotografie) quante sono le micro lenti – quindi, ad oggi, fino a decine di migliaia.

Infine (e questa è la parte più affascinante), l’immagine catturata attraverso una singola micro lente è leggermente differente rispetto a quella catturata attraverso la micro lente vicina a essa, perché i raggi di luce hanno una direzione fra loro leggermente diversa, che dipende dalla posizione della lente nel sistema di lenti (nell’Array) che sta davanti al sensore.

Ciò che catturiamo attraverso questo sistema non è una fotografia così come l’abbiamo conosciuta fino a oggi: è un set evoluto, corposo, di micro foto e d’informazioni e dati. Che dobbiamo interpretare.

- L’insieme dei raggi in un campo di luce può essere parametrizzato, matematicamente, in molti modi. Il modo più comune (e quello che c’interessa) è la parametrizzazione su due piani, essendo la più vicina alla geometria analitica delle immagini prospettiche;

- Possiamo quindi immaginare il ‘cubo di luce’ che abbiamo catturato come scomponibile in fette – come affettabile con un coltello: attraverso il nostro software, sceglieremo su quale piano tagliare l’immagine, ed è così che ne determineremo i parametri fotografici

- ci sono altri modi per simulare questo effetto: fotocamere a scatto ultra rapido in movimento, ad esempio, oppure una gamma di fotocamere fisse controllate roboticamente (come nel noto film ‘Matrix’)

https://www.youtube.com/watch?v=WDdxMBq2GW8

“Bullet time effect” (‘Matrix’ – copyright Warner Bros, qui riprodotto da Canon Svizzera)

Prossimo passo: il set di dati così ottenuto va elaborato, e servono software sofisticati (forniti dal produttore della fotocamera): i raggi di luce coerenti con un determinato punto scelto, e che hanno attraversato una delle tante micro lenti disponibili, vanno identificati, isolati e raggruppati secondo i criteri preferiti Il software deve poter analizzare:

- l’elenco dei raggi di luce coerenti;

- la loro posizione nel sistema di micro lenti;

- sll’interno dell’immagine che si va via via realizzando, le informazioni che possono essere utili alla ricostruzione di un fedele modello tridimensionale della scena

Alla fine del processo di elaborazione abbiamo tutte le potenzialità della foto fatta al ‘campo di luce’ a nostra disposizione. Possiamo stabilire noi, a posteriori e senza pensarci prima:

- che cosa è a fuoco e che cosa non lo è;

- qual è la profondità di campo che c’interessa;

- in che modo interpretiamo le prospettive

- possiamo persino creare un’immagine 3D utilizzabile da una stampante tridimensionale

Tutto questo dopo aver scattato. Non devo pensare. Posso scattare senza preoccupazioni, senza preoccuparmi della tecnica e degli errori d’esecuzione.

Raytrix GmbH è la società tedesca che per prima ha creato e commercializzato una fotocamera plenottica.

I loro modelli producono immagini con risoluzione da 1 a 3 megapixel; la definizione complessiva è di 10.7 ‘Megarays’.

La Raytrix non ha memoria interna (è fatta per essere montata in un sistema d’immagine). Luminosità: costante f/8.

Messa a fuoco e profondità di campo vengono però stabiliti dopo lo scatto, via software. L’immagine è scomponibile in un massimo di 200 piani e la velocità di cattura va da 6.1 a 10fps (fotogrammi per secondo) in piena risoluzione, a seconda del modello. Le Raytrix montano ottiche Nikon F, Canon (con adattatori), M58; Raytrix offre la possibilità di mettere a fuoco fino al singolo pixel (con software dedicato).

https://www.youtube.com/watch?v=TiA0pswZ6Z8

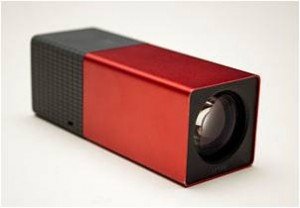

Raytrix è, abbastanza chiaramente, un prodotto molto professionale destinato principalmente all’industria e all’ingegneria. Molto più orientata al mercato di massa è Lytro [vedi anche: ‘L’immagine viva’ di Letizia Bevilacqua] .

Lytro , fondata da Ren Ng (ricercatore della Stanford University), è la società che ha brevettato e sta commercializzando le fotocamere plenottiche dedicate al mercato Consumer e ai foto amatori. Fino ad ora, ha messo sul mercato Lytro Light (dal design innovativo, ma abbastanza prototipale) e (questa estate, 2014) Lytro Illum.

I costi sono molto differenti: Lytro ‘Light Field’ è quasi una ‘fun camera’ che costa 150 dollari su ‘Amazon’ (versione 8Gb), mentre Illum ‘Professional Light Field’ (circa 1500 dollari) appare come un prodotto più maturo.

Lytro LightField (‘fun’)

Lytro LightField (‘fun’)

La Lytro LightField è in alluminio e pesa circa 200g e ha dimensioni 4x4x11cm; l’impugnatura è in gomma antiscivolo. La batteria è una ricaricabile al litio di durata adeguata (permette di scattare un numero di foto tale da riempire la memoria).

Non c’è card; le immagini vengono memorizzate nella fotocamera (8 o 16Gb per un massimo di circa 750 scatti).

La fotocamera si comanda attraverso un touch screen, posteriore; la qualità del display è piuttosto povera.

‘Lytro Light’ è stata molto ben accolta da un punto di vista di design e come concetto innovativo, ma ha ricevuto pessimi riscontri come qualità dell’immagine prodotta e capacità di controllo: molti l’hanno restituita, molti altri l’utilizzano come oggetto simpatico ma non come fotocamera alla quale affidarsi

Lunghezza focale di Lytro Light: 35 – 300 mm (35mm equivalente, con zoom ottico) . Luminosità: costante f/2 . Sensibilità: ISO 80 – 3200 . Rapidità: 8 s – 1/250.

La nuova nata Illum si presenta da subito come oggetto molto diverso.

Il sensore è di sensibilità molto superiore (40 Megarays CMOS); la fotocamera ha più o meno le dimensioni di una Mirrorless evoluta, realizzata in magnesio e alluminio e costruttivamente di buona qualità, con parti in gomma su impugnatura e obiettivo. Le immagini vengono memorizzate su card SD – circa 500 foto.

Il display è inclinabile, questa volta di buona qualità con buon angolo di visione. La fotocamera può essere collegata a utilizzatori esterni e telecomando, come nelle Reflex e Mirrorless. Supporta flash esterni.

Lunghezza focale di Lytro Illum: 35 – 300 mm (35mm equivalente, con zoom ottico) . Luminosità: costante f/2 . Sensibilità ISO: ISO 80 – 3200 rapidità: 32 s – 1/4000. Obiettivo non intercambiabile, con diametro filtro 72mm.

˜

Torniamo un attimo alla teoria e ai fatti. La fotocamera plenottica immagazzina un’immagine che potremmo definire un ‘cubo di luce’, sul quale andiamo poi ad operare dopo lo scatto: crea quindi immagini navigabili.

Ciò avviene attraverso il software sia a bordo macchina (con le funzioni implementate nella fotocamera, e accessibili via menu) che attraverso servizio professionali via Internet (messi a disposizione dai produttori).

Dell’immagine che abbiamo catturato possiamo modificare:

– prospettiva

– punti di messa a fuoco

– dimensioni

Abbiamo inoltre a disposizione altre funzioni, molto evolute:

- alterazione prospettica/parallasse: interessante è la possibilità di modificare, dopo lo scatto, la prospettiva catturata nell’immagine, spostando il punto di vista (non completamente – ma apprezzabilmente); è un po’ come ‘ruotare la testa in molte direzioni’. Questa possibilità viene offerta sia da Raytrix (che la denomina ‘Multiview’), che da Lytro (‘Perspective Shift’), ed è attualmente limitata dal diametro dell’obiettivo (sulla ‘Lytro Light’ è quindi ristretto a circa 5cm da sinistra a destra);

- messa a fuoco del singolo pixel , già disponibile con Raytrix e annunciato (ma non ancora rilasciato) da Lytro;

- misura della distanza dal soggetto: le fotocamere plenottiche sono in grado di misurare con precisione la distanza. Questo può essere molto utile in applicazioni d’ingegneria (come la misurazione di una profondità, o della distanza di un punto di riferimento);

- zoom sul soggetto scelto, dopo lo scatto: anche la compressione e la distensione dell’immagine, effetto equivalente a quello dell’uso dinamico di un teleobiettivo e di uno zoom, sono disponibili via software, e anche in questo caso dopo lo scatto;

- l’ultimo gioiello è la ridefinizione delle condizioni d’illuminazione dopo lo scatto: luci e ombre sul soggetto sono alterabili a posteriori, in quanto la fotocamera ha memorizzato tutto quello che era disponibile nel ‘cubo di luce’ catturato

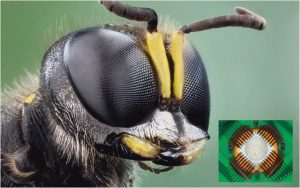

Esiste già, in natura, qualcosa di simile al sistema di lenti proprio della Lytro e della Raytrix: l’occhio dell’insetto (attualmente, oggetto di approfondito studio, teso a sviluppare telecamere speciali per i Drone).La domanda che sorge spontanea è: ma perché, allora, gli insetti vedono peggio di noi?

Esiste già, in natura, qualcosa di simile al sistema di lenti proprio della Lytro e della Raytrix: l’occhio dell’insetto (attualmente, oggetto di approfondito studio, teso a sviluppare telecamere speciali per i Drone).La domanda che sorge spontanea è: ma perché, allora, gli insetti vedono peggio di noi?

La risposta sta nella scarsa capacità di elaborazione del loro cervello e soprattutto nell’inutilità (per loro, nel loro contesto di esseri viventi) dell’elaborazione successiva: non serve al loro scopo, e capacità superiori, nella loro evoluzione, non si sono sviluppate.

L’insetto ha potenzialità visive molto superiori a quelle umane ma non può (e non gli interessa) elaborarle; il cervello umano elabora invece ottimamente quelle del suo occhio, che è un obiettivo di circa 50mm con diaframma da f/2 a f/8, molto versatile, frontale ma ben brandeggiabile e adatto a un po’ di tutto (non specifico per il volo, non specifico per la caccia … ma multifunzione). Ciascuno dei due esseri viventi si è adattato il meglio possibile al suo ecosistema; ora l’Uomo fa il passo successivo, e cerca di copiare la natura e di perfezionarla per i propri scopi (che non sono, necessariamente, gli stessi dell’ecosistema o delle leggi della natura).

L’insetto ha potenzialità visive molto superiori a quelle umane ma non può (e non gli interessa) elaborarle; il cervello umano elabora invece ottimamente quelle del suo occhio, che è un obiettivo di circa 50mm con diaframma da f/2 a f/8, molto versatile, frontale ma ben brandeggiabile e adatto a un po’ di tutto (non specifico per il volo, non specifico per la caccia … ma multifunzione). Ciascuno dei due esseri viventi si è adattato il meglio possibile al suo ecosistema; ora l’Uomo fa il passo successivo, e cerca di copiare la natura e di perfezionarla per i propri scopi (che non sono, necessariamente, gli stessi dell’ecosistema o delle leggi della natura).

Ma queste macchine, che risoluzione hanno?

Dipende.

Da che cosa? Da quello che cerchiamo. Se cerchiamo il dettaglio e l’alta qualità, Lytro e Raytrix non sono gli oggetti per noi: le immagini escono dalla fotocamera, alla fine, con una risoluzione fra 1 e meno di 10 Megapixel. Abbastanza bassa. Nulla di paragonabile alle attuali fotocamere digitali di fascia alta.

Il concetto stesso di ‘Megarays’, inoltre – di ‘quantità di raggi di luce catturati dal sensore’ (come da definizione di Lytro), è un po’ nebuloso se rapportato alle specifiche tecniche di risoluzione dell’immagine alle quali siamo abituati. 40 Megarays non ci danno una buona stampa; 4 Megapixel si.

Indubbiamente, però, nel momento in cui ci avviciniamo a questo tipo di fotocamera e decidiamo di sperimentarla la qualità non è quello che stiamo cercando: ciò che ci può attirare è l’immensa potenzialità creativa. Del resto, Lytro stessa non si presenta al mercato come ‘produttrice di fotocamere’ (anche se le influenze del mercato sono evidenti nel cambio di design da Light a Illum).

“Posso fare la stessa cosa con Photoshop!” ..?

No. Posso fare qualcosa di simile a una foto plenottica, con Photoshop, partendo da un video di buona qualità (quindi: scattando con rapidità più fotogrammi) realizzato in fuoco manuale; ma, non avendo noi utilizzato in partenza un Array di lenti ma una lente singola, le possibilità sono molto più limitate e l’effetto ‘Photoshop’ che si ottiene è diverso.

L’effetto che ottengo utilizzando fotocamere stereoscopiche o filmando e poi elaborando (tecnica complessa) è un’altra cosa rispetto a una foto plenottica ed è percettibile. Le foto stereoscopiche, peraltro, sono già in giro da un po’ di tempo e hanno di per sé stesse natura e scopo differente.

Il ‘riflusso – via da Photoshop!’ è peraltro già abbastanza evidente in molti campi: il recentissimo film ‘Interstellar’ di Christoper Nolan utilizza la computer grafica in maniera estremamente minore rispetto alle tendenze dell’ultimo decennio.

Luce! Ma in direzione opposta. Ovvero: dove andremo a finire?

Le applicazioni del ‘campo di luce’ e delle nuove tecnologie emergenti sono sensazionali.

HP Labs ha sviluppato qualche anno fa una tecnologia che permette la proiezione 3D e la visione dell’immagine tridimensionale senza dispositivi di supporto (senza occhiali); è sul mercato, è stata già sperimentata nel corso della campagna elettorale americana del presidente Barack Obama, ed è equivalente a quella del film ‘Guerre Stellari’ (1977). L’uomo sogna; poi, realizza.

ll proiettore WRAP (‘sistema di specchi riflettenti per radiazioni coerenti’) utilizza un sistema – un Array – di micro specchi anziché di micro lenti. Questi specchi, semi trasparenti e orientati opportunamente, permettono di combinare l’immagine del mondo reale con quella generata virtualmente. Realtà aumentata, e – quasi – Ponte Ologrammi di ‘Star Trek’.

ll proiettore WRAP (‘sistema di specchi riflettenti per radiazioni coerenti’) utilizza un sistema – un Array – di micro specchi anziché di micro lenti. Questi specchi, semi trasparenti e orientati opportunamente, permettono di combinare l’immagine del mondo reale con quella generata virtualmente. Realtà aumentata, e – quasi – Ponte Ologrammi di ‘Star Trek’.

Il Super LightField Lens di Pixar (2010): la nota casa cinematografica, ha depositato i progetti di lenti plenottiche utilizzabili con fotocamere e ottiche tradizionali che possono creare sistemi d’immagine a ‘campo di luce complessa’; questo perché la tecnologia delle ottiche tradizionali e la qualità dei sensori delle Reflex è molto avanzato. Questi sistemi sono tesi non tanto alla cattura dell’immagine, ma alla successiva manipolazione della stessa – per una fotografia, e un cinema, virtuale, nel quale non ci sarà più bisogno di soggetti umani

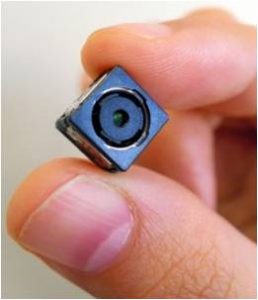

Due anni fa, inoltre, Toshiba ha annunciato un modulo con obiettivo plenottico di circa 1 x 1 x 1cm, con risoluzione 8 Megarays CMOS.

Due anni fa, inoltre, Toshiba ha annunciato un modulo con obiettivo plenottico di circa 1 x 1 x 1cm, con risoluzione 8 Megarays CMOS.

Questo modulo contiene 500.000 micro lenti di 30 µm; cinque volte il numero di micro lenti disponibile nella Lytro Light. La risoluzione effettiva sarà di 2 Megapixel, ma la prossima generazione, già in fase di studio, avrà un sensore da 13 Megarays e risoluzione di 6 Megapixel. Messa a fuoco dopo lo scatto, messa a fuoco selettiva sul singolo pixel e separazione da primo piano o sfondo saranno tutte disponibili anche sul modulo Toshiba, e la notissima casa a ha già proposto partnership a tutti i maggiori produttori di Smartphone mondiali.

Le fotocamere plenottiche e il nostro ‘cubo di luce affettabile’ richiedono, per poter essere tradotti in immagine comprensibile e visibile, una grande potenza d’elaborazione: per un ‘pieno uso’ e per avere in mano un oggetto effettivamente veloce e ben funzionante ci vorrà ancora qualche anno, ma … questi anni saranno indubbiamente pochi.

Esse sfidano, in effetti, tutti i concetti da tempo consolidati relativamente a risoluzione, immagine, composizione. Costringono, quindi, i produttori di fotocamere a ripensare le loro strategie e, cosa forse più importante, costringono noi a ripensare le nostre fotografie e a valutare il significato stesso dell’atto creativo insito nello scatto.

“La fotografia è morta”, quindi?

Certamente no. Quello che intendiamo per ‘fotografia’ è infatti molto diverso dal 3D, dalle riprese video a trecentosessanta gradi e anche dall’immagine plenottica; dire “la fotografia è morta” equivale a speculare su un altro assurdo, che potrebbe essere qualcosa del tipo: “il ritratto è morto”.

Il ritratto rimarrà comunque ritratto: il mezzo tecnico cambierà, com’è già cambiato nel corso della storia.

Ciò che è sicuro, è che con la foto del ‘campo di luce’ nasce oggi una nuova forma d’arte, che non può essere più distinta dall’arte digitale, che non può essere ignorata e che ci farà vedere cose senz’altro emozionanti. La fotografia ‘è morta e sta per morire’. Ecco, il Punctum, sia esso in due o in quattro dimensioni, è questo: l’emozione.

“In questo spazio … io sono talvolta attratto (ma, ahimé, raramente) da un ‘particolare’. Io sento che la sua sola presenza modifica la mia lettura, che quella che sto guardando è una nuova foto, contrassegnata ai miei occhi da un valore superiore.” (Roland Barthes)

Roberto Srelz © centoParole Magazine – riproduzione riservata